人工知能(AI)は近年目覚ましい進歩を遂げています。 しかし、AI 幻覚とは何か、そしてそれを克服する方法を理解することは、LLM 作成者にとって依然として進行中のプロセスです。

今日および将来のテクノロジーは、特に AI が人間の言語をどのように理解して生成できるかに関して、私たち全員を魅了し続けます。 大量のテキストでトレーニングされるコンピューター プログラムであるラージ言語モデル (LLM) によって、大きな進歩が遂げられました。 これらの LLM は、詩、コード、スクリプト、楽曲、電子メール、手紙など、さまざまな種類のクリエイティブなテキスト形式を作成できます。

ただし、これらの印象的なモデルの力によって生じる特有の問題があります。それは、時々「幻覚」を起こすことです。

AI幻覚とは何ですか?

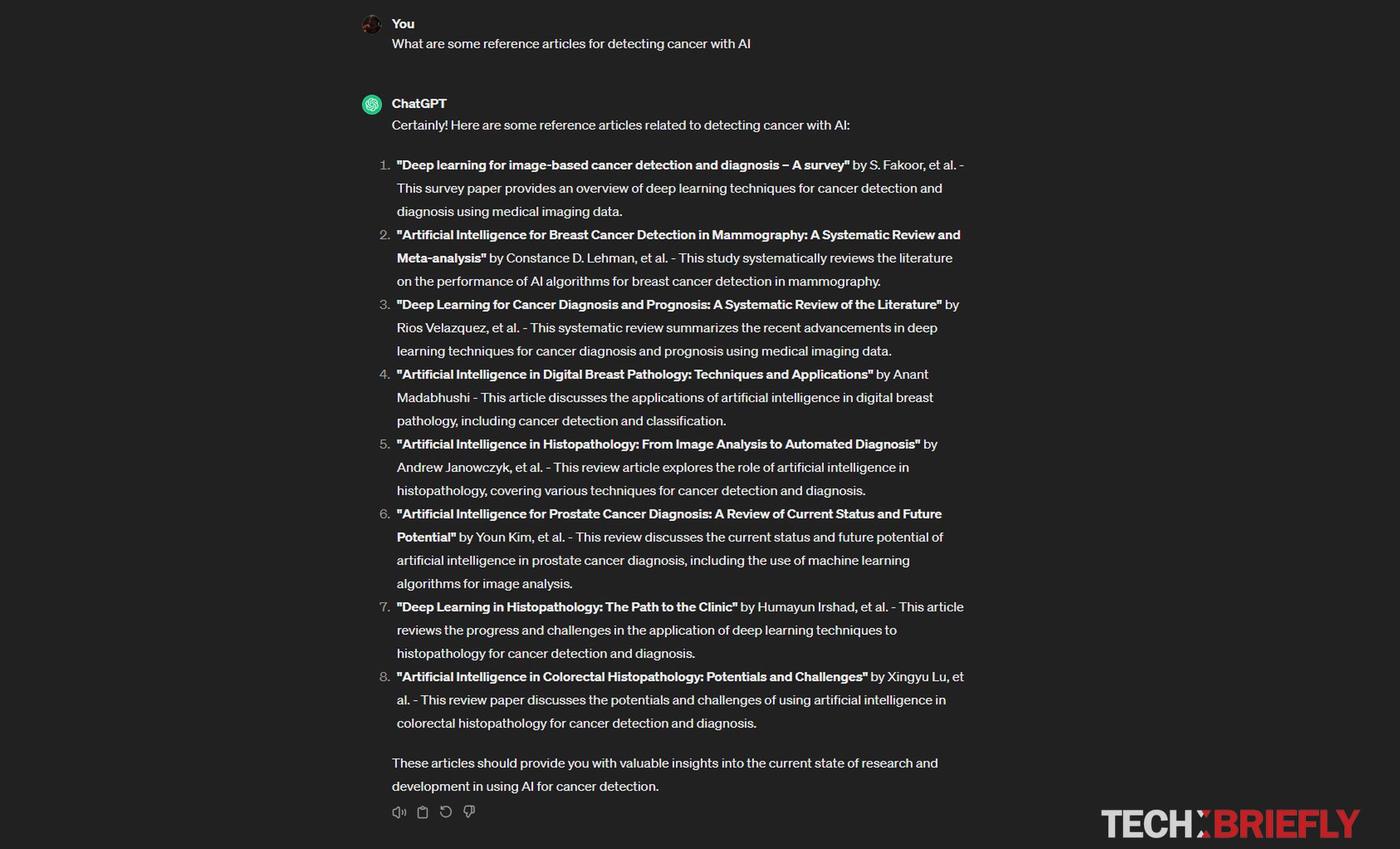

人間が現実ではないものを想像したり空想したりできるのと同じように、AI も同様のことを行うことができます。 AI の幻覚は、LLM が信じられそうなテキストを生成するときに発生しますが、事実は間違っています。 こうした幻覚は、小さな間違いから完全にでっち上げられた話や意味不明な発言まで多岐にわたります。

この問題をよりよく理解するために、いくつかの例を見てみましょう。

- 事実を混同する:ある出来事に関するニュース記事を書くように頼まれた AI には、間違った日付や場所が含まれたり、関係者を偽ったりする可能性があります。

- falseの作成 情報: 製品の説明を書く任務を負った AI は、実際にはその製品にはない機能を発明する可能性があります。

- 自信を持って間違っています: AI の幻覚について本当に厄介なのは、それらが非常に説得力のある方法で提示されることが多く、実際の情報と区別するのが難しいことです。

LLM にとって幻覚が問題となるのはなぜですか?

AI 幻覚とは何かについての説明からわかるように、AI 幻覚はいくつかの理由から LLM にとって重大な問題です。 まず、LLM が生成するテキストを信頼できない場合、ユーザーはテクノロジーの全体的な有用性と信頼性に対する信頼を失います。 LLM によって書かれたニュース記事のオンライン要約を読んでいると想像してください。 概要に事実誤認が含まれている場合は、その情報源の使用を完全に中止する可能性があります。 これは、チャットボット、仮想アシスタント、自動コンテンツ作成ツールなど、LLM に依存してテキストを生成するアプリケーションにとって大きな問題となる可能性があります。

第二に、AI の幻覚が誤った情報の拡散に寄与する可能性があります。 フェイクニュースがすでに大きな懸念となっている時代において、AIが生成した信憑性があるように見えるテキストは、簡単に本物の情報と間違われる可能性があります。 これは、公の場での議論から重要な意思決定プロセスに至るまで、あらゆるものに悪影響を与える可能性があります。 たとえば、LLM が政治候補者に関する虚偽の情報を含むソーシャル メディア投稿を作成していると想像してください。

こうした投稿は有権者を誤解させ、選挙結果を左右する可能性がある。 それが、GoogleがGeminiの選挙関連のクエリへの応答機能を無効にしたまさにその理由だ。

第三に、LLM を使用する企業や組織は、AI システムが不正確または有害なコンテンツを生成した場合、風評被害に直面する可能性があります。 企業が LLM を使用してオンライン ストアの製品説明を作成しているとします。 LLM が実際の製品にはない機能を発明した場合、顧客の不満を招き、会社の評判を傷つける可能性があります。

AIの幻覚はなぜ起こるのか?

AI の幻覚についてはある程度の考えはありますが、なぜそのようなことが起こるのでしょうか? この問題にはいくつかの要因が考えられます。

- 彼らはどのように訓練されるのか: LLM には膨大な量のテキスト データが供給されます。 このデータには、多くの場合、エラー、偏見、古い情報が含まれています。 AI は、正しい情報から学習するのと同じように、このデータから学習します。

- 理解と創造: LLM は言語のパターンを理解するのが得意ですが、現実世界の概念やロジックを常にしっかりと理解しているわけではありません。 実際には真実ではないのに、もっともらしく聞こえる何かを生成することがあります。

- 流暢さの追求: LLM は、自然で人間らしく聞こえるテキストを生成するように設計されています。 場合によっては、これは AI の知識にギャップがある可能性がある「空白を埋める」ことを意味します。 これらの空白を埋めていくと、AI がコンテンツを作成する可能性があります。

これを解決するために何が行われていますか?

AI コミュニティの研究者や開発者は、AI の幻覚を軽減する方法に積極的に取り組んでいます。

アプローチには次のようなものがあります。

- より良いトレーニングデータ: エラーやバイアスが含まれる可能性が低い慎重に厳選されたデータセットを作成し、AI の動作の向上につながります。

- ファクトチェック: AI が生成したテキストを信頼できるソースと相互参照し、その正確性を確保する技術を開発します。

- 説明可能性: 推論プロセスを説明できる LLM の設計により、潜在的なエラーを発見しやすくなります。

- 人間とAIのコラボレーション: 人間と AI が連携するシステムを構築し、幻覚の特定と修正を容易にします。

これらすべてに加えて、Nvidia の Jensen Huang 氏は、AI 幻覚は今後 5 年以内に治療できると述べています。

したがって、AI の幻覚は複雑な課題ですが、LLM が潜在能力を最大限に発揮したい場合には、克服する必要がある重要な課題です。 幻覚を軽減するテクノロジーがより洗練されるにつれ、LLM はコミュニケーション、創造性、知識タスクのためのより信頼できる価値のあるツールになることが期待されています。

注目の画像クレジット: vackground.com/Unsplash