Facebookチームは、視覚障害のあるユーザー向けに設計されたテクノロジーである、プラットフォームに投稿された写真を記述するために使用するAIの大幅な改善を発表しました。

2016年にFacebookによって設計されたこのシステムは、より高速でより正確なダイナミクスを提供するように改善されました。 しかし、最新のアップデートでは、写真のより詳細な説明を提供できるため、さらに一歩進んでいます。

FacebookはAIを改善して、視覚障害のあるユーザーを支援します

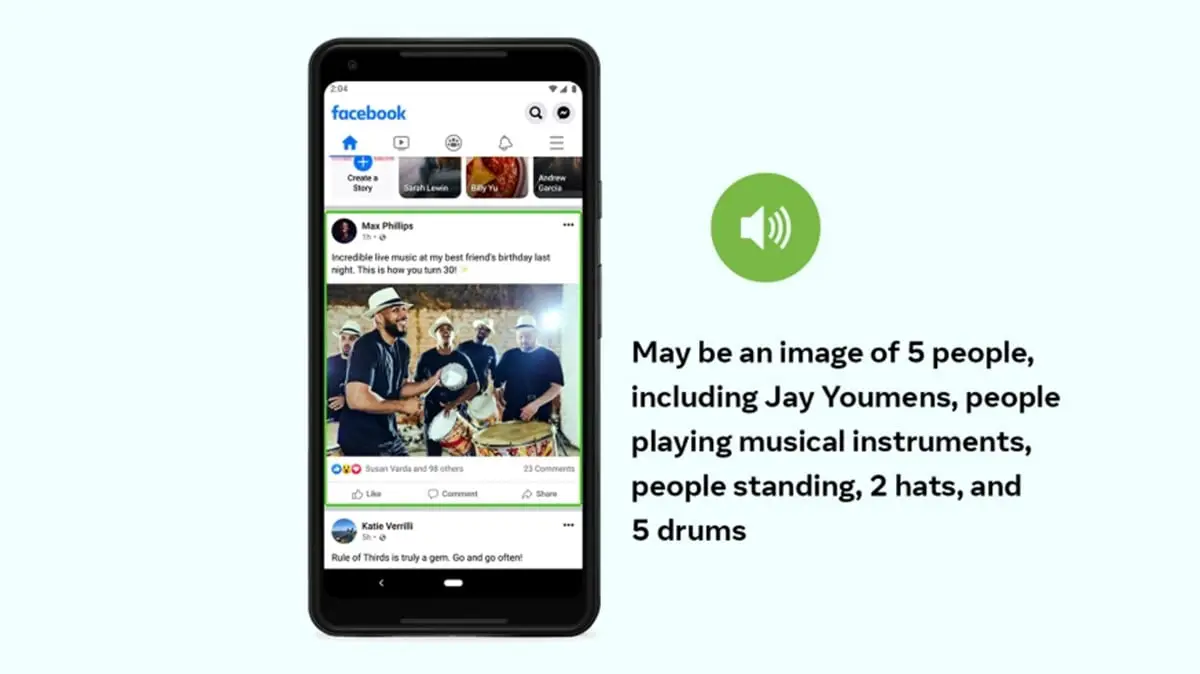

Facebookに投稿されたすべての画像について、人工知能はシーンを説明しようとする字幕を自動的に生成します。 Facebookは、このプロジェクトで画像の個々の要素だけを説明するのではなく、シーン全体を伝えて、ユーザーがコンテキストを理解し、投稿を楽しむことができるようにすることを望んでいます。

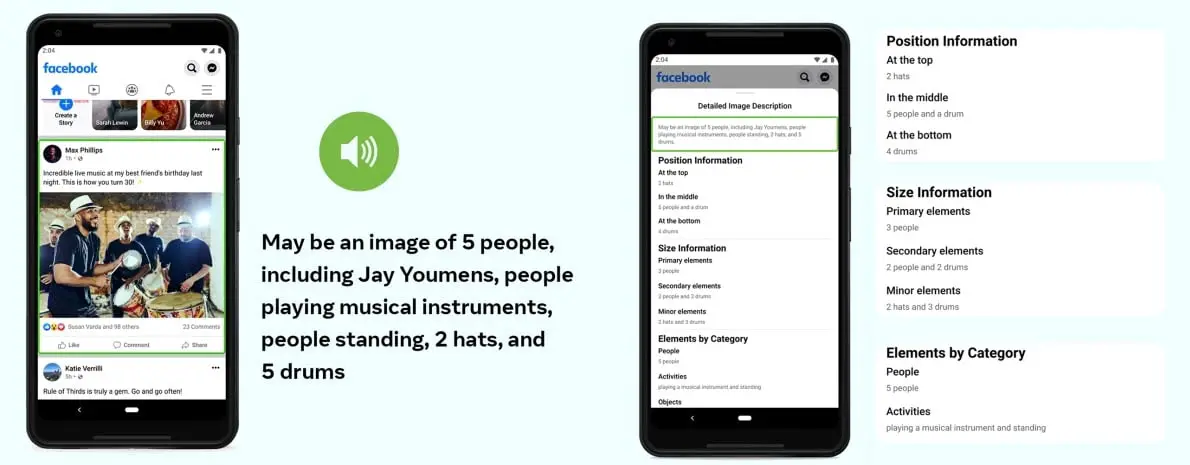

この新しいバージョンのAIに存在する目標は、すでに多くの要素を認識し、シーンのより詳細な説明を提供できます。 人や動物がいるかどうかを区別できるだけでなく、さまざまな種類の活動、場所、さらには要素の位置も認識できます。

たとえば、上の画像では、人工知能は帽子をかぶって太鼓を叩いている人が5人いることを認識できました。 しかし、それだけでなく、シーンがどのように設定され、どの要素が重要であるかを説明することもできます。 写真でわかるように、すべての情報は、シーンのコンテキスト全体が理解できるように分類されています。

このすべての情報は、視覚障害者が友人が写真で何を共有しているかを理解するのに役立ちます。 もちろん、フィードに表示されるすべての写真についてその情報を取得したくない場合もあるため、Facebookでは、より詳細な説明を受け取るタイミングを選択できます。