Googleは、ウェブページを動画に変えるAIプロジェクトを実験しています。 まだ一般公開されていませんが、興味深いプロジェクトです。 その名前はURL2Videoであり、その操作は、アプリケーションによって自律的に選択および編集されるテキスト、画像、フォント、色、およびその他の重要な要素の抽出に基づいています。

このツールの背後にある操作のメカニズムは、視聴覚作品とウェブデザインの両方に精通しているデザイナーによって送信された経験に基づいてGoogleで設計されました。 このようにして、選択基準とコンテンツの階層化を考慮して、エディションのいくつかの一般的なスタイルが定義されました。

- Googleマップの新しい運転モードは、まもなくすべての人が利用できるようになります

- GoogleはGoogleOneサービスに無料のVPNを追加します

- GoogleのLoonが成層圏最長飛行の記録を樹立:312日

研究プロトタイプであるURL2Videoを利用するには、使用するURLの先頭を指定する必要があります。 ここから、上記の自動メカニズムを介して要素が選択されます。 生成されたクリップのデザインは、Webサイトの外観と一致します。

これらの最初のデータを処理した後、ユーザーは、ビデオの予想される長さやアスペクト比など、いくつかのパラメーターを定義するように求められます。 生成されたクリップの最終レンダリングの前に、このアプリケーションのユーザーインターフェイスを使用すると、ユーザーは特定のデザイン属性(色、フォントなど)などのいくつかの要素を編集できます。 最初のテストの後、GoogleはURL2Videoでこれまでに得られた結果の肯定的な評価を行います。

「私たちは、ビデオ編集でオーディオトラックとナレーションをサポートする新しい技術を開発しています。 全体として、クリエイターが高レベルの意思決定に集中し、MLモデルが複数のプラットフォームでの最終的な動画作成のために、詳細な時間的およびグラフィカルな編集をインタラクティブに提案する未来を想定しています。」 グーグルの研究スタッフのペギー・チーとイルファン・エッサは言った。

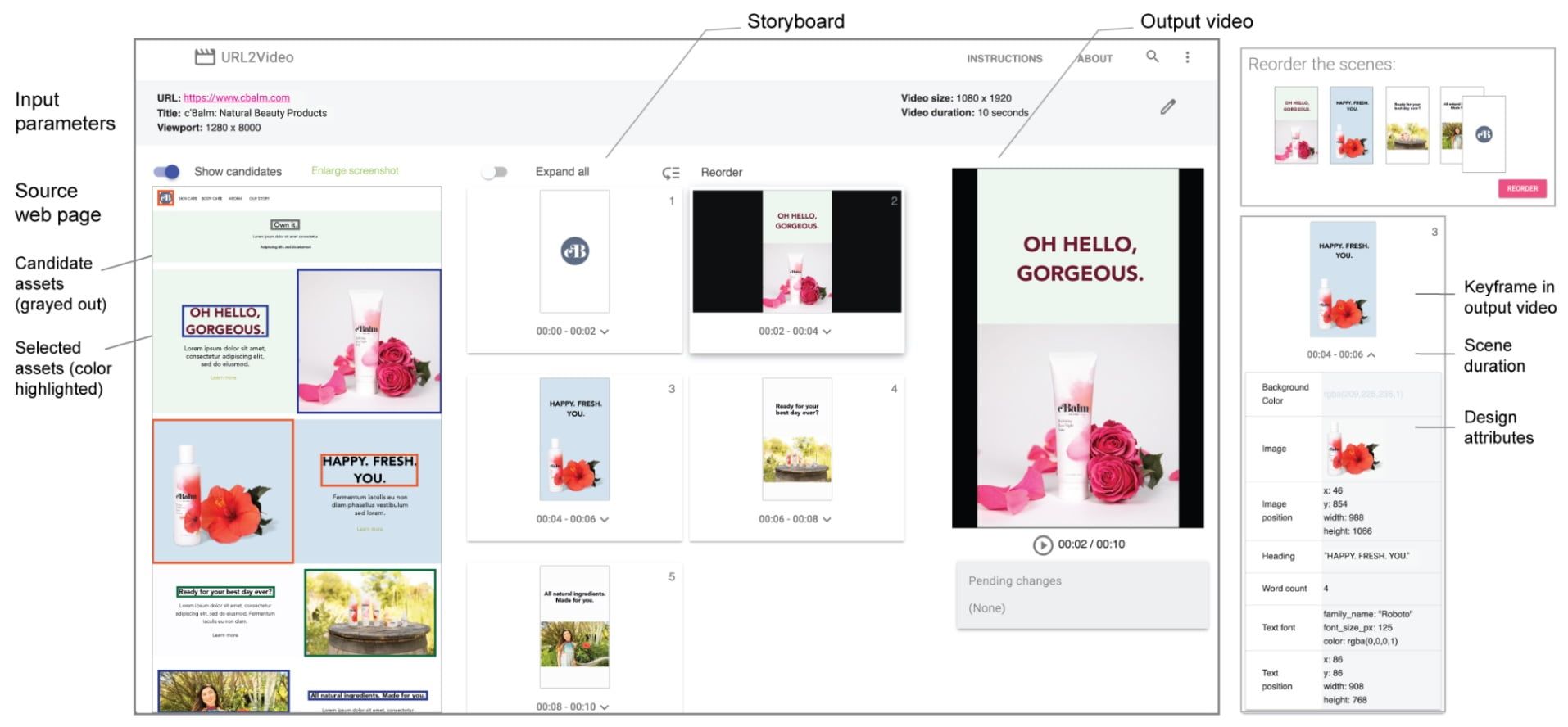

URL2Video作成インターフェイスで、ユーザーはURL、ターゲットページビューのサイズ、およびビデオ出力パラメーターを指定します。 URL2Videoはサイトを分析し、主要なビジュアルコンポーネントを抽出します。 一連のシーンを作成し、キーフレームをストーリーボードとして表示します。 これらのコンポーネントは、入力の時間的および空間的制約を満たす出力ビデオに処理されます。 ユーザーは、ビデオを再生し、デザイン属性を調べ、シーンの再配置など、ビデオのバリエーションを生成するための調整を行うことができます。

URL2Videoは、UI2020ソフトウェアおよびテクノロジーシンポジウムで発表されました。 プロトタイプレベルでは、ペーパーはこのプロジェクトの研究段階で開発された主な技術的詳細を指定します。

人工知能の可能性の注目に値するデモンストレーションであることに加えて、このツールは将来、いくつかのサイトのコンテンツを販売するための視聴覚資料を自動的に生成する優れた代替手段として統合される可能性があります。

Googleは、ウェブページを動画に変換するAIプロジェクトを実験していますが、まだ公開されていません。 しかし、それは私たち全員にとってエキサイティングなプロジェクトです。