Google DreamBooth AI が登場しました。 OpenAI の DALL-E 2 や StabilityAI の Stable Diffusion や Midjourney などの新しくリリースされたテクノロジは、すでにインターネットを席巻しています。 次に、結果をカスタマイズします。 しかし、どのように? ボストン大学と Google から回答がありましたので、詳しく説明します。

DreamBooth には、写真のトピックを認識し、元のコンテキストから解体し、新しい望ましいコンテキストに正確に合成する機能があります。 さらに、現在の AI 画像ジェネレーターで使用することもできます。 AI を活用したイマジネーションの詳細については、読み進めてください。

Google DreamBoot AI の説明

Google は、テキストから画像への新しい拡散モデルである DreamBooth を発表しました。 Google DreamBooth AI は、テキスト プロンプトを指示として使用して、さまざまな条件でユーザーが選択したトピックのさまざまな画像を作成できます。

DreamBooth は、事前に十分にトレーニングされたテキストから画像へのモデルを変更するための革新的な方法であり、ボストン大学と Google の研究チームによって作成されました。 全体として、アイデアはかなり単純です。ユーザーが作成したい特定のトピックにまれなトークン ID が関連付けられるように、言語視覚辞書を拡張したいと考えています。

Google DreamBooth AI の主な機能:

- 3 ~ 5 枚の写真を使用すると、DreamBooth AI によってテキストから画像へのモデルが強化される場合があります。

- DreamBooth AI を使用すると、被写体の完全にオリジナルのフォトリアリスティックな画像を作成できます。

- さらに、DreamBooth AI は、さまざまな視点から被写体の画像を生成することができます。

モデルの主な目的は、選択した主題のインスタンスの写実的な表現を作成し、それらをテキストから画像への拡散モデルに接続するために必要なツールをユーザーに提供することです。 その結果、この方法は、さまざまな状況で問題を要約するのに有効であると思われます。

Google の DreamBooth は、DALL-E 2、Stable Diffusion、Midjourney などの最近リリースされた他のテキストから画像へのツールとは多少異なるアプローチを採用しており、ユーザーはトピックの画像をより詳細に制御し、テキストベースの入力を使用して拡散モデルを制御できます。

DreamBooth は、数枚の入力写真だけで、さまざまなカメラ アングルからトピックを表示することもできます。 人工知能 (AI) は、入力された写真がさまざまな視点からのトピックに関するデータを提供しない場合でも、被写体の資質を予測し、それらをテキスト ガイド付きナビゲーションで合成する場合があります。

このモデルは、写真を合成して、言語の手がかりを使用して、他のムード、アクセサリー、または色の変化を作成することもできます。 これらの機能により、DreamBooth Google AI はユーザーにさらにパーソナライズと創造の自由を提供します。

DreamBooth の記事「DreamBooth: Subject-Driven Generation のための Text-to-Image 拡散モデルの微調整」は、1 つの新しい問題とアプローチを提供すると主張しています。

- サブジェクト主導の世代は新鮮な問題です。

急いで撮影された被写体の画像がいくつか与えられた場合、目標は、さまざまな設定で被写体の新しい表現を作成すると同時に、その主要な視覚的特性を忠実に再現することです。

Google のアプリケーション ドリームブースAI

上位の Google DreamBooth AI アプリケーションは次のとおりです。

- 再文脈化

- アート演出

- 式操作

- 新規ビュー合成

- アクセサリー化

- プロパティの変更

PhotoShop を手放す準備はできていますか? によって作成された有益な写真を使用して、それらをより詳しく調べてみましょう。 ナタニエル・ルイス そしてDreamBoothクルー。

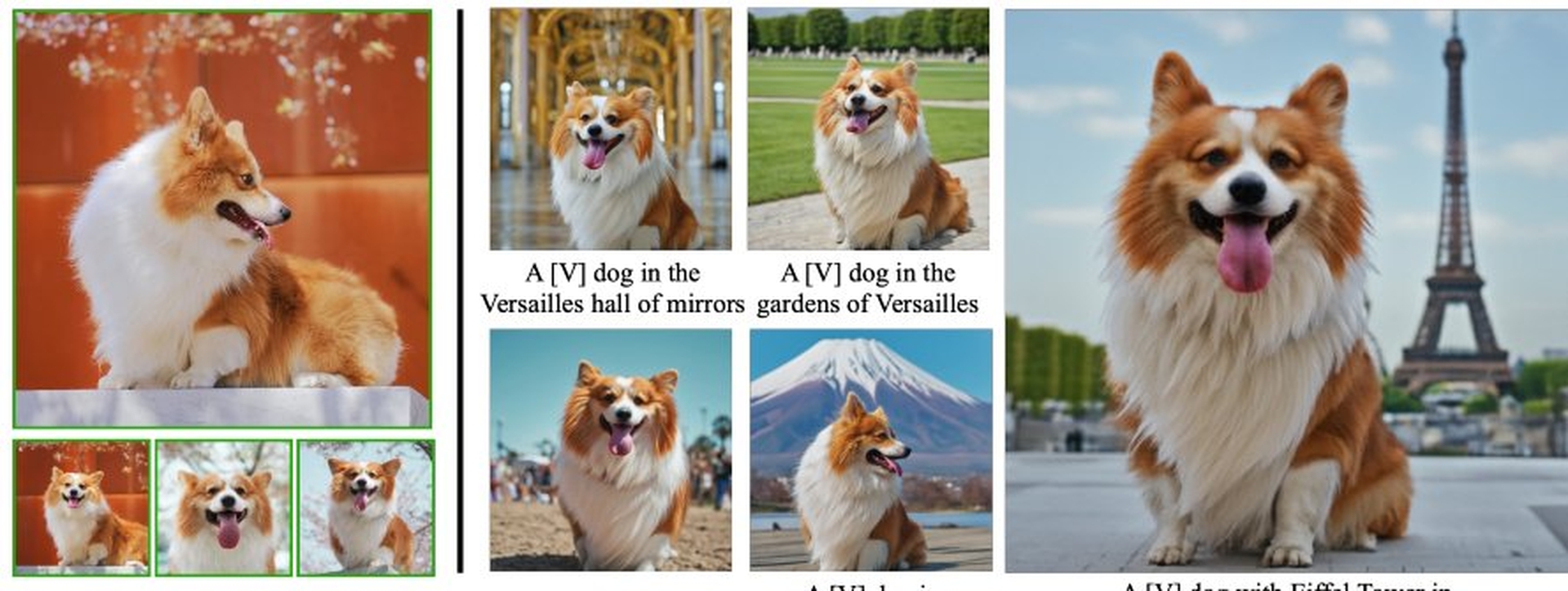

再文脈化

一意の識別子とクラス名詞を含むフレーズをトレーニング済みモデルに供給することにより、DreamBooth AI は特定のサブジェクト インスタンスに対して一意の画像を作成する場合があります。 背景を変更する代わりに、DreamBooth AI は、これまでにない革新的なポーズ、関節、シーン構造で被写体を生成する場合があります。 リアルな影と反射、および被写体と隣接するオブジェクトとの相互作用。 これは、彼らの戦略が単に関連情報を推定または取得する以上のものを提供していることを示しています。

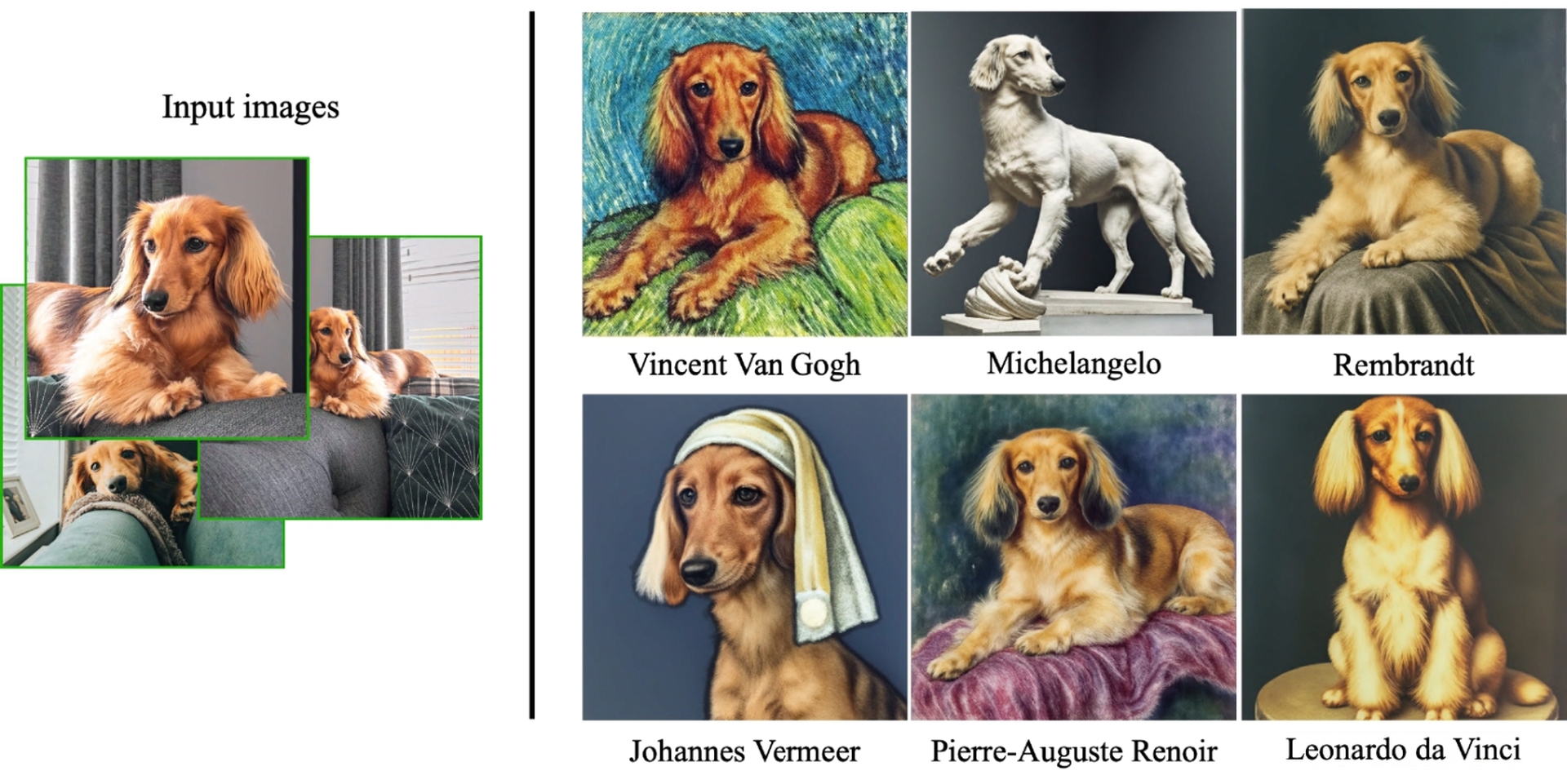

アート演出

「の彫像」から選択するオプションが与えられた場合 [V] [class noun] のスタイルで [great sculptor]」と「の絵 [V] [class noun] のスタイルで [famous painter]」 あなたならどちらを選びますか? DreamBooth AI を使用して、オリジナルのクリエイティブ表現を作成できます。

特に、このタスクは、別の画像のスタイルを元のシーンに適用しながらソース シーンのセマンティクスを保持するスタイル転送とは異なります。 対照的に、クリエイティブ スタイルによっては、AI はサブジェクト インスタンスの詳細と ID の保持により、シーンを大幅に変更する場合があります。

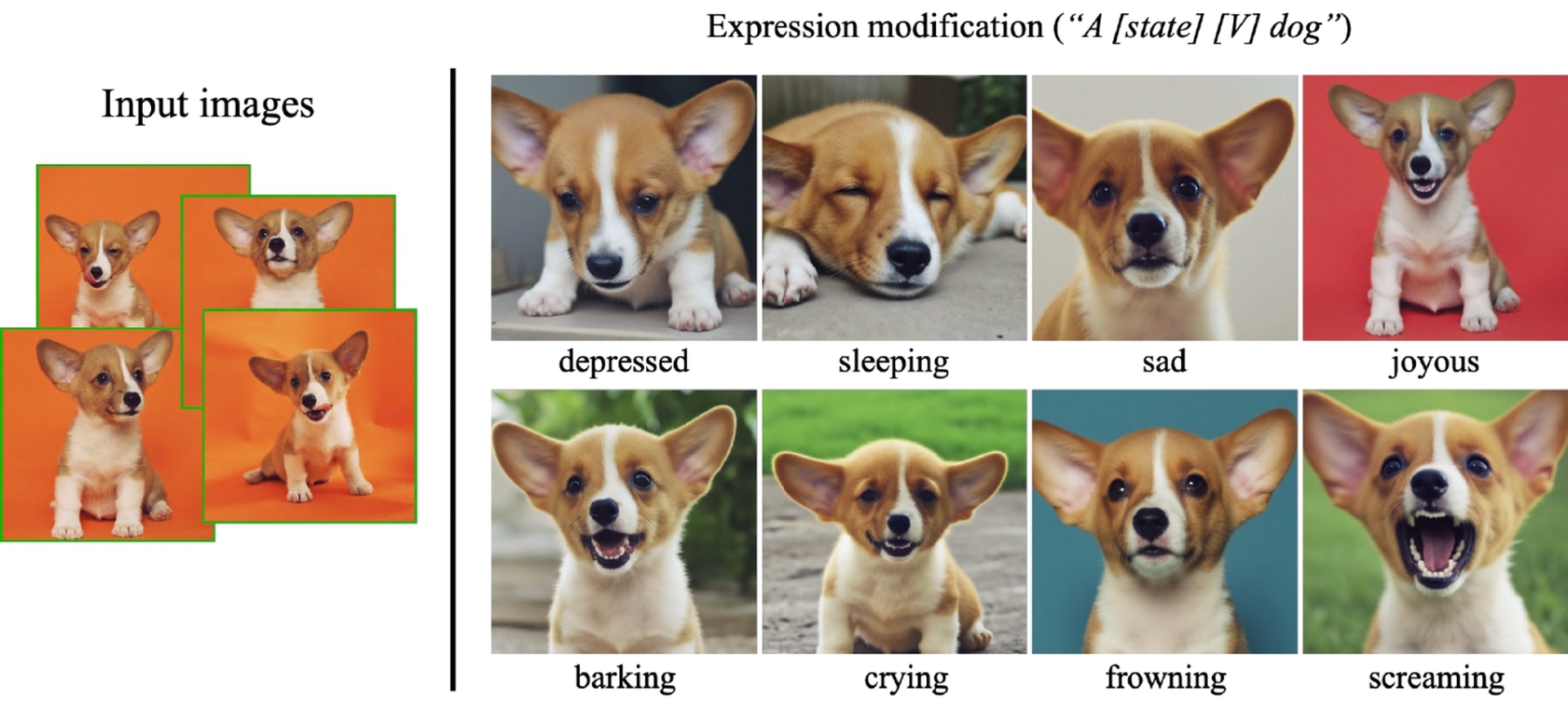

式操作

Google DreamBooth AI の方法を利用して、元の写真セットとは異なる表情の被写体の新しい写真を作成することができます。

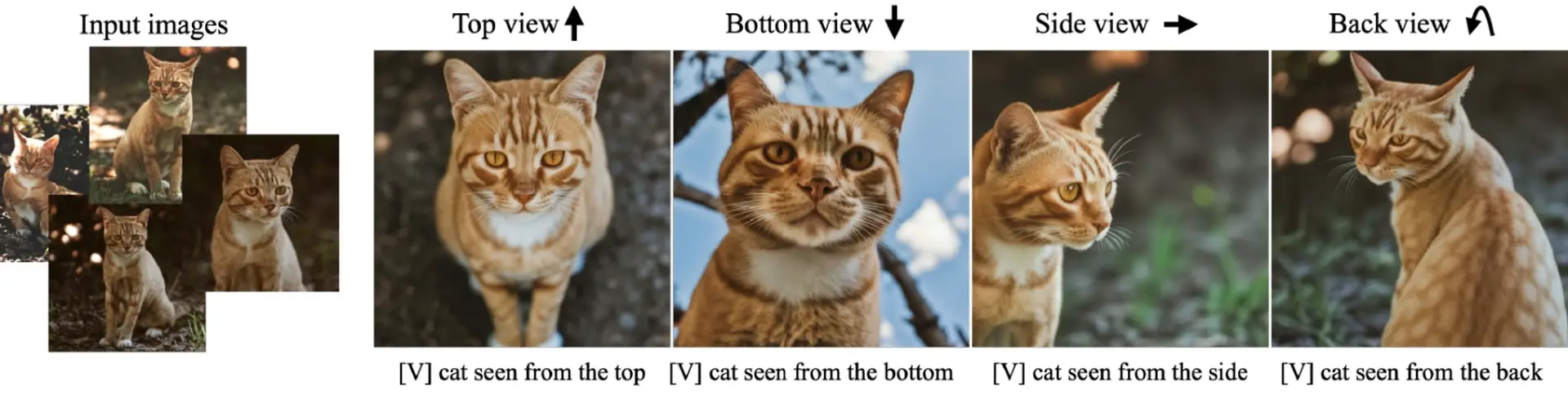

新規ビュー合成

Google DreamBooth AI は、さまざまな独自の視点からトピックを描写することがあります。 たとえば、DreamBooth AI は、さまざまなカメラ アングルを使用して同じ猫の新鮮な画像を生成し、信頼性の高い詳細な毛皮パターンでいっぱいにすることができます。

モデルには猫の正面写真が 4 枚しかないにもかかわらず、DreamBooth AI は、この同じ猫を横から、下から、または上から見たことがなくても、これらの創造的な視点を作成する前にクラスから情報を推測することができます。

アクセサリー化

オブジェクトを装飾する DreamBooth AI の能力の興味深い側面は、生成モデルの強力な合成事前情報に由来します。 説明のために、モデルは「a」という形式の文で促されます。 [V] [class noun] 身に着けている [accessory]」。 これにより、魅力的な方法でさまざまなオブジェクトを犬に取り付けることができます。

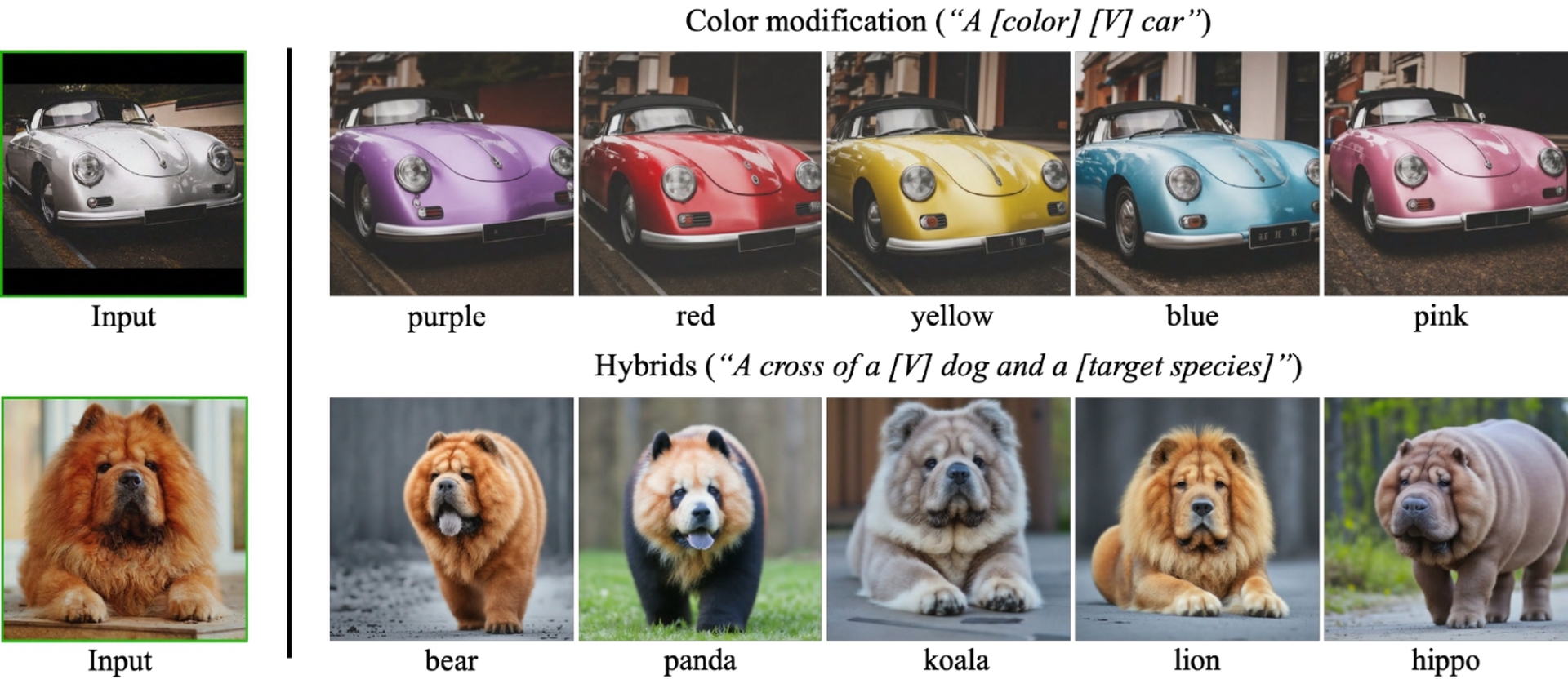

プロパティの変更

DreamBooth AI は、サブジェクト インスタンスのプロパティを変更できます。 色の形容詞は、例文「a」で使用できます。 [color adjective] [V] [class noun]」。 これにより、トピックの新鮮で鮮明なインスタンスが得られる場合があります。 いくつかの要件がありますが、これらの特性は、DreamBooth AI の利用方法についても説明しています。

Google DreamBooth AI を使用していますか?

DreamBooth AI 手法は、被写体 (特定の犬など) の少数の写真 (通常は 3 ~ 5 枚の画像で十分です) とそれに関連付けられたクラス名 (「犬」など) を入力として受け取ります。 次に、微調整されて「パーソナライズ」されたテキストから画像へのモデルを生成し、トピックの一意のアイデンティティをエンコードします。 さまざまなコンテキストでトピックを合成するために、DreamBooth AI は、推論時に固有の識別情報をさまざまなフレーズに挿入する場合があります。 被写体の画像が 3 ~ 5 枚ある場合、テキストから画像への拡散を次の 2 つの手順で調整できます。

- 特定のコードと対象が属するクラスの名前を含むテキスト プロンプト (たとえば、「a picture of a [T] canine」)は、低解像度のテキストから画像へのモデルを強化するために使用されます。 さらに、クラス固有の事前保存損失を使用します。これは、モデルのセマンティック プライアをクラスで活用し、テキスト プロンプトにクラス名を入力することで、サブジェクトのクラスのメンバーである一連の例を生成することを奨励します (たとえば、 、「犬の絵」)。

- 入力画像セットからの低解像度と高解像度の写真のペアを使用して超解像度コンポーネントを調整することにより、優れた忠実度を実現します。

最初の Dreambooth は、Imagen のテキストから画像へのパラダイムを使用して作成されました。 ただし、Imagen のモデルと重みは利用できません。 ただし、いくつかの例を使用すると、Stable Diffusion の Dreambooth を使用すると、ユーザーはテキストから画像へのモデルを調整できます。

Stable Diffusion で Google Dreambooth AI を使用するには?

Stable Diffusion で DreamBooth AI を利用するには、次の手順に従います。

- Textual Inversion リポジトリまたは元の Stable Diffusion リポジトリのセットアップ手順に従って、LDM 環境をセットアップします。

- 安定した拡散モデルを微調整するには、トレーニング済みの安定した拡散モデルを受け取り、その指示に従う必要があります。 HuggingFace からウェイトをダウンロードできます。

- Dreambooth の微調整方法の必要に応じて、正則化のために一連の画像を準備します。

- 次のコマンドを使用して練習できます。

|

1

2

3

4

5

6

7

8

|

python main.py --base configs/stable-diffusion/v1-finetune_unfrozen.yaml -t --actual_resume /path/to/original/stable-diffusion/sd-v1-4-full-ema.ckpt -n <job name> --gpus 0, --data_root /root/to/training/images --reg_data_root /root/to/regularization/images --class_word <xxx> |

世代

トレーニング後、コマンドを使用してパーソナライズされた例を取得できます。

|

1

2

3

4

5

6

7

|

python scripts/stable_txt2img.py --ddim_eta 0.0 --n_samples 8 --n_iter 1 --scale 10.0 --ddim_steps 100 --ckpt /path/to/saved/checkpoint/from/training --prompt "photo of a sks <class>" |

特に、class> はクラス ワード (訓練用のクラス ワード) であり、sks は識別子です (変更したい場合は、選択したものに置き換える必要があります)。 詳細については、DreamBooth Stable Diffusion の GitHub ページにアクセスしてください。

Dreambooth AI の制限事項

DreamBooth AI の制限は次のとおりです。

- 言語のドリフト

- 過剰適合

- 保存損失

それらをさらに詳しく調べてみましょう。

言語のドリフト

コマンド プロンプトが原因で、トピック内で詳細度の高い反復を生成することが妨げられています。 DreamBooth はトピックのコンテキストを変更できますが、モデルが実際の主題を変更したい場合、フレームに問題があります。

過剰適合

もう 1 つの問題は、出力画像が元の画像にオーバーフィットする場合です。 十分な数の入力写真がない場合、被写体が評価されなかったり、アップロードされた画像のコンテキストと組み合わされたりする可能性があります。 これは、奇数世代のコンテキストが要求された場合にも発生します。

保存損失

まれなトピックやより複雑なトピックの写真を合成できないこと、および幻覚性の変化や不連続な品質をもたらす可能性のある可変的な主題の忠実度が、さらに制限されます. 入力コンテキストは、入力画像のトピックに含まれることがよくあります。

AIの社会的影響

DreamBooth プロジェクトの目的は、さまざまな設定で個人的なトピック (動物、オブジェクト) を合成するための実用的なツールをユーザーに提供することです。 標準的なテキストから画像へのアルゴリズムは、単語から画像を合成する際に特定の側面に偏っている可能性がありますが、ユーザーが選択した主題をより適切に再現するのに役立ちます。 ただし、悪意のある者が類似の画像を使用してユーザーをだまそうとする可能性があります。 さまざまな生成モデル手法やコンテンツ変更手法で、この問題が蔓延しています。

結論

テキストから画像へのモデルの大部分は、単一のテキスト入力から出力を作成するために、何百万ものパラメーターとライブラリを必要とします。 DreamBooth では、ユーザーが簡単にコンテンツを入手して使用できるようにします。3 つから 5 つのトピックの画像と背景の書き込みを入力するだけで済みます。

したがって、トレーニングされたモデルが画像から学習した主題の物質的な側面を再利用して、他の設定や視点でそれらを複製する一方で、トピックの独特の品質が保持される場合があります。 ほとんどのテキストから画像への変換アルゴリズムは特定のキーワードに依存しており、画像を表示するときに特定の属性を優先する場合があります。 DreamBooth のユーザーは、選択した人物を独自の環境またはシナリオで見ることにより、写真のようにリアルな結果を生み出すことができます。 だから、今すぐ待つのをやめてください。 今試してみて!

Stable Diffusion で Google Dreambooth AI を使用する方法に関するこの記事をお楽しみいただけたでしょうか。 そうした場合は、DALL-E 2 がアウトペインティングを導入しました: AI は国境を越えて想像する、または Stable Diffusion AI アート ジェネレーター: プロンプト、例、および実行方法など、他の記事もお読みいただけると確信しています。

Source: Stable Diffusion で Google Dreambooth AI を使用するには?