ソーシャルネットワークが開催したコンテストの結果によると、Twitterの自動写真トリミングアルゴリズムは「若くて薄くて色白の顔」を支持していました。

同社は今年3月に自動写真トリミングを無効にしました。 多くのユーザーは、グループ画像を投稿するときに、黒人よりも白人が強調されていると指摘しました。

Twitterが主催したコンテストは状況を裏付けました。 人工知能の専門家である参加者は、ネットワークのシステムに影響を与えたバイアスを強調しました。

受賞者は、アルゴリズムが「若く、スリムで、色白の顔、滑らかな肌の質感、典型的には女性的な特徴」を支持していることを示しました。 1位はEPFLの大学院生であるBogdanKulynychでした。彼は$ 3,500を受け取りました。

第二に、白髪や白髪の人に偏っており、年齢差別を示唆していることが指摘された。

3位である間、それは画像のアラビア語の書き込みよりも英語を好むことが注目されました。

TwitterのAIの改善を探しています

システムは絶えず開発されているので、まだ改善できることを忘れないでください。 Twitterが探していたのは、専門家の意見と調査結果に基づいて、自動写真トリミングのより良いガイドラインでした。

TwitterのMETAチームの責任者であるRummanChowdhuryは、 分析 結果。

3位は @RoyaPak バイリンガルミームを使用してTwitterの顕著性アルゴリズムを実験した人。 このエントリは、アルゴリズムがアラビア文字よりもラテン文字のトリミングをどのように優先するか、およびこれがオンラインの言語の多様性に対する害の観点から何を意味するかを示しています。

— Twitterエンジニアリング(@TwitterEng) 2021年8月9日

彼は次のように述べています。「モデルのバイアスについて考えるとき、それは学術的または実験的なものだけではありません」と幹部は言いました。 (それは)それが私たちの社会に対する考え方ともどのように機能するかについてです。」

「私は「人生を模倣した芸術、そして芸術を模倣した芸術」というフレーズを使用します。 これらのフィルターを作成するのは、それが美しいと考えているためです。その結果、モデルをトレーニングし、魅力的であることが何を意味するのかという非現実的な概念を推進することになります。」

TwitterのMETAチームは、機械学習の倫理、透明性、説明責任を研究しています。

勝者はどのようにして結論に達しましたか?

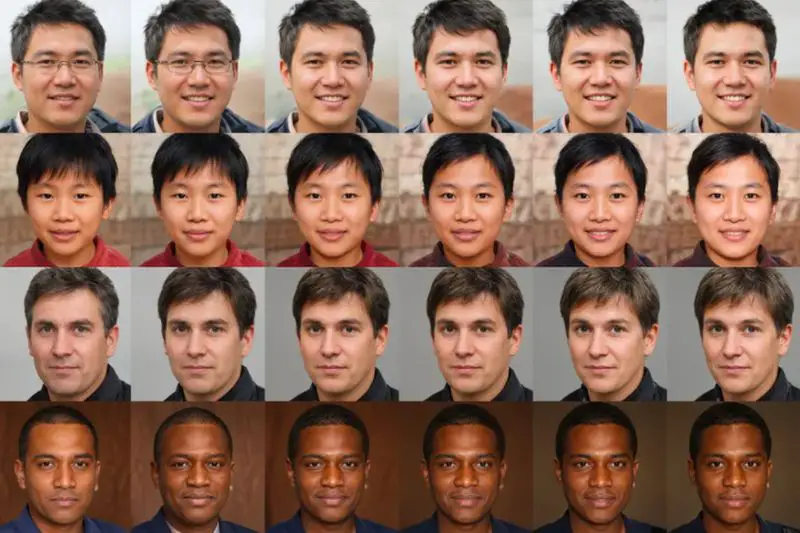

Bogdan KulynychがTwitterのアルゴリズムについて結論を出すために、彼はStyleGAN2と呼ばれるAIプログラムを使用しました。 それを使って、彼は肌の色だけでなく、女性対男性の顔の特徴と薄さによって変化する多数の実際の顔を生成しました。

うわー、これは今週の予想外の結論でした! 私の提出物は、Twitterのアルゴリズムバイアスプログラムで1位を獲得しました。 どうもありがとう @ruchowdh、 @TwitterEng METAチームと審査員…

— Bogdan Kulynych(@hiddenmarkov) 2021年8月8日

Twitterが説明しているように、Kulynychはバリアントをネットワークの自動写真トリミングアルゴリズムにフィードし、どれが彼のお気に入りであるかを見つけました。

「(彼らは)体重、年齢、肌の色に関するアルゴリズムの好みを満たさなかったものをトリミングしました」と専門家は彼の結果で強調しました。

企業と人種的偏見、あなたはそれらにどのように対処しますか?

Twitterは、そのコンテストで、アルゴリズムシステムにおける社会的バイアスの蔓延する性質を確認しました。 ここで、新たな課題が発生します。これらのバイアスとどのように戦うか。

「AIと機械学習は、データサイエンスチームがどれほど熟練していると思っていても、まさにワイルドウェストです」とAI研究者のPatrickHall氏は述べています。

「あなたが間違いを見つけていない場合、またはバグバウンティがあなたの間違いを見つけていない場合、誰があなたの間違いを見つけていますか? エラーがあるからです。」

彼の言葉は、他の会社が同様の失敗をしたときに、他の会社の仕事に耳を傾けました。 The Vergeは、MITチームがAmazonの顔認識アルゴリズムに人種や性別の偏見を発見したとき、同社は研究者の信用を失墜させたことを思い出します。

その後、これらのアルゴリズムの使用を一時的に禁止する必要がありました。